Moderne Websites und Online Shops für deine digitale Erfolgsgeschichte.

Automatisiert Daten auslesen, aufbereiten und auswerten. Lass deine Arbeitsabläufe optimieren und spare Zeit.

Schon seit meiner frühesten Kindheit interessiere ich mich für Computer und Elektronik. Gemeinhin würde man mich wohl als Nerd bezeichnen. Ganz so schlimm ist es aber nicht. In den wenigen Stunden an denen man mich nicht vor dem PC findet, bin ich im Wald, auf einem Berg oder dabei mich mit dem Mountainbike in Gefahr zu bringen. Seit neuestem habe ich auch das Windelwechseln für mich entdeckt.

Mein Job ist es deine Ideen und Wünsche zu realisieren. Damit das klappt arbeite ich mit den folgenden Technologien.

Die Zusammenarbeit mit Oliver hat wirklich reibungslos geklappt. Oliver war stets wie vereinbart erreichbar, hat alle Aufgaben verlässlich und weit vor der vereinbarten Zeit erledigt und stand auch für Rückfragen immer zur Verfügung. Das Ergebnis kann sich durch seinen Einsatz wirklich sehen lassen. Vielen Dank für die gute und unkomplizierte Zusammenarbeit 🙂

Seit dem ersten Beratungsgespräch überzeugt Oliver Sulzer mit seiner kompetenten und super freundlichen Art. Oliver hat uns einen tollen Onlineshop gemacht, für den wir ständig Komplimente bekommen und der einwandfrei funktioniert. Oliver reagiert irrsinnig schnell und unkompliziert auf Anliegen – eine wirklich angenehme Zusammenarbeit! Es hat bisher noch nichts gegeben, was er nicht konnte. Wir sind wirklich froh, ihn ‚gefunden‘ zu haben und können ihn nur jedem weiterempfehlen!

Wir arbeiten inzwischen seit mehreren Jahren in vielen verschiedenen Projekten zusammen und es ist jedes mal eine Freude das Ergebnis zu sehen.

Menschlich und fachlich kompetent und gewissenhaft.

Wünsche werden prompt umgesetzt … geht nicht, gibt’s nicht!

Was nicht passt, wird passend gemacht.

Oliver ist stets freundlich, hilfsbereit und beantwortet auch Fragen.

Vielen Dank an dieser Stelle für die gute Zusammenarbeit.

Ich freue mich schon auf zukünftige Projekte.

Herr Sulzer ist hervorragend auf unsere Wünsche eingegangen und hat die Weiterentwicklung unserer WordPress Seite maßgeblich unterstützt. Er hat auf Anfragen immer sehr schnell geantwortet, hat verlässlich alle Termine eingehalten und sehr gute eigene Ideen eingebracht. Wir sind mit dem Ergebnis sehr zufrieden.

Zuverlässig und kompetente Beratung. Projekte werden professionell abgewickelt, die Kommunikation erfolgt rasch und immer zielführend. Wir freuen uns auf eine weiterhin gute Zusammenarbeit!

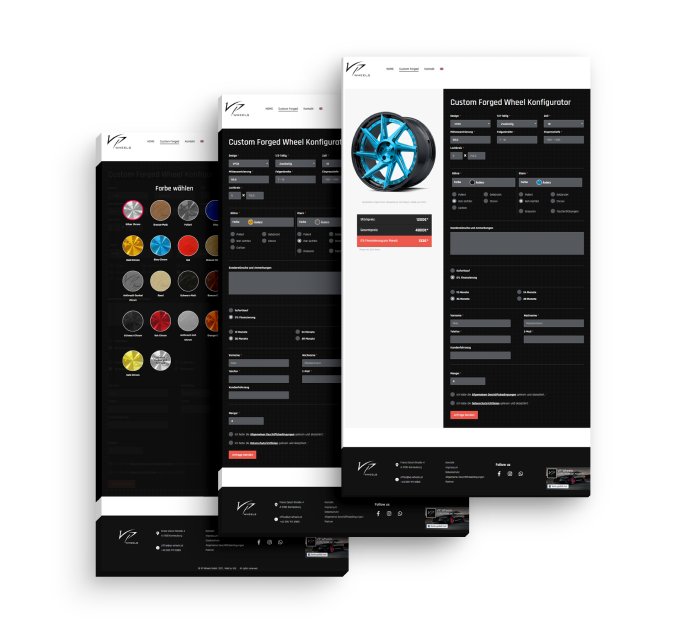

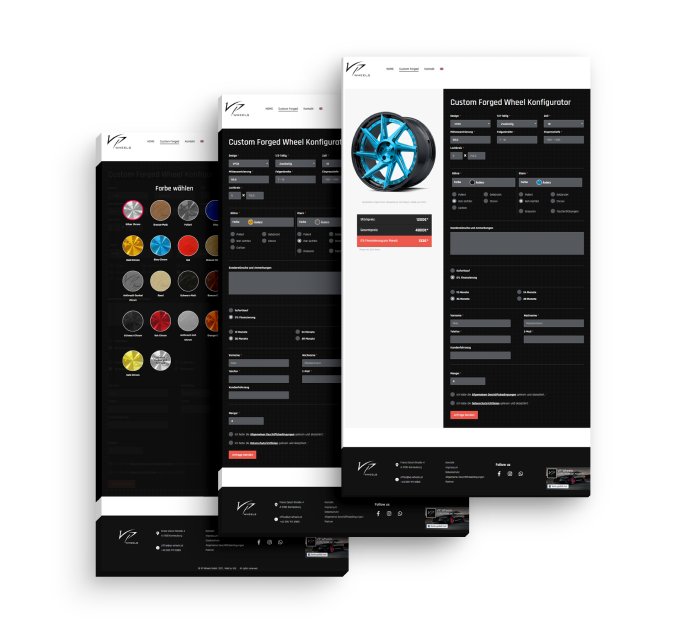

VP Wheels bietet speziell nach Kundenwunsch gefertigte Felgen basierend auf hauseigenen Designs. Um es Besuchern zu ermöglichen, alle Kombinationen bereits im Vorfeld frei zu konfigurieren wurde ein Konfigurator benötigt. Neben der grafischen Darstellung war auch die Berechnung des Preises ein wichtiger Punkt.

Der neue Auftritt von Unwired Networks besticht durch klare Strukturen und ein aufgeräumtes Design. Das Design wurde für den Kunden als eigenständiges WordPress Theme umgesetzt. Alle Inhalte können vom Kunden selbst bearbeitet und erweitert werden. Details wie aktuelle Jobs wurden über einen Custom Post Type umgesetzt.

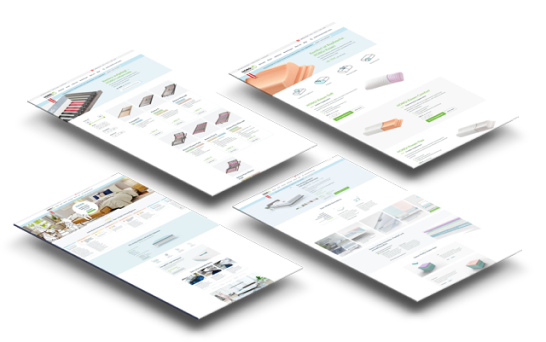

Bei HONGi kann man mithilfe eines einfachen Konfigurators eine auf die eigenen Bedürfnisse zugeschnittene Matratze generieren und bestellen. Probiere es doch einfach aus.

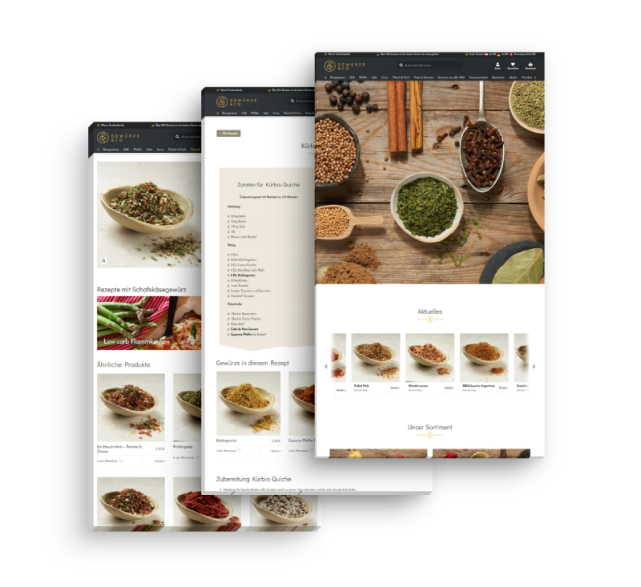

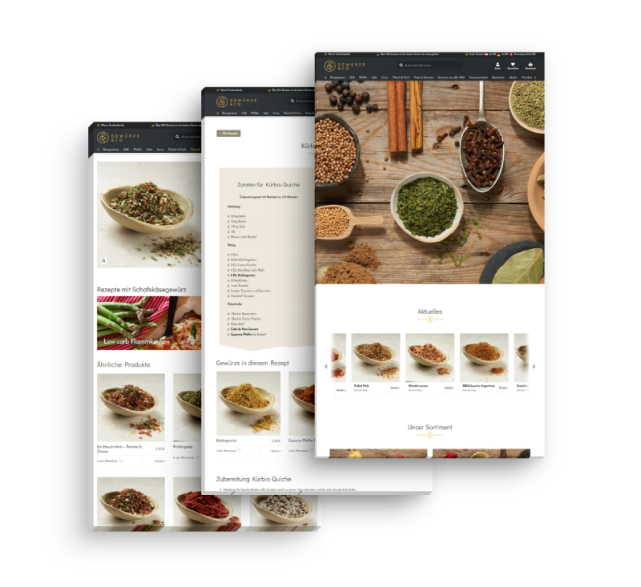

Gewürze & Co hat ein großes Sortiment an tollen Gewürzen im Angebot. Die Gewürz Experteninnen/Experten von Gewürze & Co wollten ein eigens für Sie gefertigtes WordPress Theme und die Möglichkeit einfach Inhalte bearbeiten zu können.

Schick mir einfach eine E-Mail oder melde dich direkt telefonisch. Es gibt keine Hotline, mit der unten angegeben Nummer hast du einen direkten Draht zu mir.

Dieses kleine Snippet entstand aus einem Problem bei der steuerlichen Berechnung von Wertgutscheinen die über das WooCommerce Plugin „Ultimate Gift Cards for WooCommerce“ und Germanized entstanden ist. Aufgrund der Art…

Als Betreiber seiner eigenen Website kennt man das Problem, sobald man seine E-Mail auf der eigenen Website veröffentlicht folgen kurz darauf die ersten Spam-Nachrichten. Diese kommen dabei nicht nur über…

Mit der neuesten WooCommerce Version 8.5 wird derzeit eine neue Funktion ausgeliefert die eine Bestellzuordnung ermöglichen soll. Dazu werden diverse Cookies gesetzt mit deren Hilfe Besucher die aus Kampagnen und…

WordPress erfreut sich seit einigen Jahren einer immer größeren Beliebtheit. Mittlerweile ist das CMS sogar das am weitest verbreitetste Publishing System. Neben der Umsetzung deines Designs als eigenständiges Theme biete ich auch die Entwicklung spezialisierter Plugins.

Spezialisierte Lösungen für viele Anwendungsgebiete. Mithilfe von Laravel setze ich aufwändige Web-Projekte um. Funktionelle Lösungen für dein Unternehmen, API-Schnittstellen oder Kundenbereiche. Erfahre was alles möglich ist.

Erfahre was mithilfe von automatisierten Crawlern alles möglich ist. Lass Daten automatisiert von Websites auslesen und in Datenbanken speichern, erhalte E-Mails wenn neue Inhalte verfügbar sind oder lass komplexe Arbeitsaufgaben automatisieren.

Das Internet ist heutzutage nicht mehr aus unserem Leben wegzudenken. Allgegenwärtig erlaubt es Zugriff auf das größte Wissensarchiv das die Welt jemals gesehen hat. Neben aktuellen Neuigkeiten aus aller Welt nutzt man das Internet heutzutage auch wenn man z.B. auf der Suche nach Handwerkern ist, sich über Produkte informieren möchte oder einkaufen will. Eine passende Website hilft dabei gefunden zu werden, dient als Werbefläche, als durchgehend geöffnetes Ladenlokal oder als immer zugängliche Informationsplattform für die eigenen Produkte und Dienstleistungen.

Eine erstellte Website muss heutzutage neben den passenden Informationen auch technische Voraussetzungen erfüllen. Mit dem aufkommen von Smartphones und Tablets veränderte sich auch das Nutzungsverhalten des Internets. Geht es nach aktuellen Statistiken werden in Österreich etwa 40 Prozent aller Suchanfragen über mobile Geräte abgesetzt. Die eigene Website muss also auch auf kleineren Geräten gut aussehen und noch wichtiger, schnell laden. Hinzu kommen aktuelle Änderungen wie z.B. durch die DSGVO. Diese gibt Informationspflichten vor und definiert auch wie mit Anfragen z.B. über ein Kontaktformular umgegangen werden sollte. Die von mir erstellten Websites werden konform der aktuellen Gesetzlage entwickelt, du kannst dich also entspannt auf deine eigentliche Arbeit konzentrieren. Natürlich werden alle von mir erstellten Websites auch für die Darstellung auf mobilen Geräten optimiert. Diese Optimierung ist natürlich optional da speziell bei der Entwicklung von Lösungen für Intranets diese Funktionen nicht immer notwendig sind. Möglich ist vieles, sprechen wir darüber – Kontaktiere mich.

Besonders der direkte Draht zum Kunden ist wichtig. Neben der Entwicklung von neuen Websites biete ich auch die Überarbeitung bestehender Seiten an. Dies betrifft Websites die bereits in die Jahre gekommen sind, nur aus einer Hauptseite (Homepage) bestehen oder mit neuen Funktionen ausgestattet werden sollen. Von Fall zu Fall empfehle Ich hierbei andere Vorgehensweisen. Oftmals empfiehlt es sich eine betroffene Website komplett neu zu entwickeln und Logos sowie Farbgebungen zu übernehmen, schlussendlich entscheiden aber natürlich du welche arbeiten durchgeführt werden sollen. Gerne unterstütze ich dich auch bei der Nutzung des Content Management Systems oder helfe bei der Auswahl der passenden Inhalte für deine Website.

Auch die schönste Website macht wenig Sinn wenn die darauf befindlichen Informationen nicht gefunden werden. Aus diesem Grund werden von mir erstellte Websites bereits mit der sogenannten Suchmaschinenoptimierung im Hinterkopf konzipiert und aufgebaut. Neben der sogenannten On-Page-Optimierung die bei jeder meiner Websites durchgeführt wird, bietet sich auch die Optimierung über externen Weg an. Links auf deine Website von qualitativen Quellen können die Reihung bei Google positiv beeinflussen. Die Eintragung in Google Maps, kann richtig eingesetzt dazu führen das speziell Leute aus deiner Umgebung auf Dienstleistungen und Produkte aufmerksam werden. Themenrelevante Verlinkungen von anderen Seiten sorgt anschließend dafür das deine Website auch in der Google-Suche weiter nach oben rutscht. Diese Optimierung ist ein organischer Prozess der über mehrere Wochen bis sogar Monate in Anspruch nehmen kann. Ausschlaggebend ist dabei die Konkurrenz für die gewählten Suchbegriffe. – Mehr zu meinem Angebot zum Thema Suchmaschinenoptimierung.

Neben der Website Erstellung in Wien und Niederösterreich übernehme ich auch gerne die Entwicklung von speziellen Lösungen für WordPress. Auf Wunsch erstelle Ich spezialisierte Themes oder Plugins. Gerne arbeite ich auch an Speziallösungen wie z.B. Erweiterungen für WooCommerce. Mehr über meine Angebote im Bezug auf WordPress erfährst du auf der Seite „WordPress Entwicklung“.

Weiters biete ich die spezialisierte Entwicklung von Spidern und Crawlern an. Bei Web-Crawlern handelt es sich um automatisierte Roboter die Informationen aus Websites und Datensätzen auslesen und diese aufbereiten können. Crawler können viele Arbeitsschritte erheblich vereinfachen, mehr dazu findest du unter „Web-Crawler / Spider Entwickler“.

Bürozeiten:

Montag – Donnerstag: 9:00 – 17:00 Uhr

Freitag: 9:00 – 14:00 Uhr